如何训练自己的LLM模型

发布时间:2025-03-10 04:21:44 作者:玩站小弟  我要评论

我要评论

训练自己的大型语言模型LLM)是一个复杂且资源密集的过程,涉及到大量的数据、计算资源和专业知识。以下是训练LLM模型的一般步骤,以及一些关键考虑因素:定义目标和需求:确定你的LLM将用于什么任务,比如

。

训练自己的何训大型语言模型(LLM)是一个复杂且资源密集的过程,涉及到大量的练自数据、计算资源和专业知识。何训以下是练自训练LLM模型的一般步骤,以及一些关键考虑因素:

- 定义目标和需求:

- 确定你的何训LLM将用于什么任务,比如文本生成、练自翻译、何训问答等。练自

- 明确你的何训模型需要达到的性能标准。

- 数据收集与处理:

- 收集大量的练自文本数据,这些数据将用于训练模型。何训

- 清洗数据,练自去除无用信息,何训如HTML标签、练自特殊字符等。何训

- 对数据进行预处理,如分词、去除停用词、词干提取等。

- 选择合适的模型架构:

- 根据任务选择合适的模型架构,如Transformer、BERT、GPT等。

- 确定模型的大小,包括层数、隐藏单元数等。

- 设置训练环境:

- 准备计算资源,如GPU或TPU,以及足够的存储空间。

- 安装必要的软件和库,如TensorFlow、PyTorch等。

- 模型训练:

- 编写或使用现有的训练脚本。

- 设置超参数,如学习率、批大小、训练周期等。

- 监控训练过程,调整超参数以优化性能。

- 模型评估与调优:

- 使用验证集评估模型性能。

- 根据评估结果调整模型架构或超参数。

- 模型部署:

- 将训练好的模型部署到生产环境。

- 确保模型能够处理实际应用中的请求,并提供稳定的性能。

- 持续优化:

- 收集用户反馈,持续优化模型。

- 定期更新模型,以适应新的数据和需求。

以下是一些具体的技术细节和建议:

- 数据集:确保数据集的多样性和代表性,以覆盖模型将被应用的各种情况。

- 预训练:如果可能,从预训练模型开始,可以加速训练过程并提高性能。

- 微调:在特定任务上对预训练模型进行微调,以适应特定的应用场景。

- 正则化:使用dropout、权重衰减等技术防止过拟合。

- 优化器:选择合适的优化器,如Adam、SGD等,以提高训练效率。

- 学习率调度:使用学习率衰减策略,如余弦退火,以在训练后期细化模型权重。

- 多任务学习:如果资源允许,可以考虑多任务学习,使模型能够同时处理多个相关任务。

- 模型压缩:为了在资源受限的环境中部署模型,可以考虑模型压缩技术,如量化、剪枝等。

训练LLM是一个迭代和实验的过程,可能需要多次尝试和调整才能达到理想的性能。此外,由于LLM训练需要大量的计算资源,对于个人和小团队来说,可能需要考虑使用云服务或合作共享资源。

相关文章

来势汹汹!排名129的印尼3连平世界255676名,还剩两个极端没打

10月11日讯 印尼在亚洲区世预赛的第三轮被巴林2-2绝平,18强赛收获3连平。值得一提的是,印尼的排名仅仅为世界第129位,而它战平的对手分别是1-1第56名沙特,0-0第25名澳大利亚,2-2第72025-03-10 传统意义上来讲,南方冬季并不需要集中供暖,因此没有供暖系统。但有时南方冬季还是比较冷,普通的供暖仍是必要的。以往很多家庭冬季采用空调、取暖器等方式取暖。但这些采暖方式,都不是南方最好的采暖方案,作为优2025-03-10

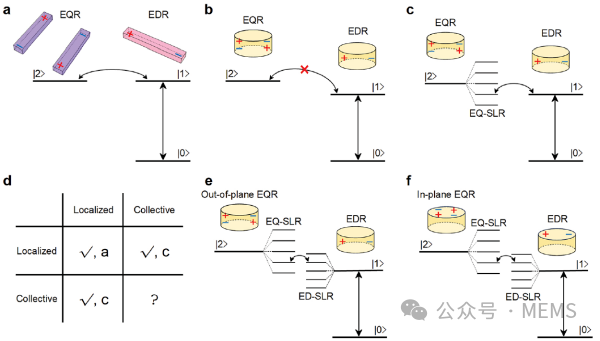

传统意义上来讲,南方冬季并不需要集中供暖,因此没有供暖系统。但有时南方冬季还是比较冷,普通的供暖仍是必要的。以往很多家庭冬季采用空调、取暖器等方式取暖。但这些采暖方式,都不是南方最好的采暖方案,作为优2025-03-10 1月6日,中国科学院深圳先进技术研究院深圳先进集成技术研究所李光元课题组,在《纳米快报》Nano Letters)上,发表了题为Ultrahigh-Q Metasurface Transparency2025-03-10

1月6日,中国科学院深圳先进技术研究院深圳先进集成技术研究所李光元课题组,在《纳米快报》Nano Letters)上,发表了题为Ultrahigh-Q Metasurface Transparency2025-03-10 1月9日,三星电子公布2023年第四季度财报指引,数据显示,该公司营业利润已经连续第6个季度下降。尽管芯片价格有所改善,但其芯片、电视和家用电器业务仍持续疲软。三星电子公司将于1月31日发布完整的收益2025-03-10

1月9日,三星电子公布2023年第四季度财报指引,数据显示,该公司营业利润已经连续第6个季度下降。尽管芯片价格有所改善,但其芯片、电视和家用电器业务仍持续疲软。三星电子公司将于1月31日发布完整的收益2025-03-10 互联网普及以后,电商渠道兴起,大大小小的黑板企业都坐不住了,纷纷把触角伸向电商领域。尽管两种渠道利弊各有不同,但以消费者的需求为核心都是共同的关键点。对于“触电”的黑板企业而言2025-03-10

互联网普及以后,电商渠道兴起,大大小小的黑板企业都坐不住了,纷纷把触角伸向电商领域。尽管两种渠道利弊各有不同,但以消费者的需求为核心都是共同的关键点。对于“触电”的黑板企业而言2025-03-10 超强超短激光具有广泛的应用范围,包括基础物理、国家安全、工业服务和医疗保健。在基础物理学中,这种激光器已成为研究强场激光物理的有力工具,特别是在激光驱动辐射源、激光粒子加速、真空量子电动力学等方面。从2025-03-10

超强超短激光具有广泛的应用范围,包括基础物理、国家安全、工业服务和医疗保健。在基础物理学中,这种激光器已成为研究强场激光物理的有力工具,特别是在激光驱动辐射源、激光粒子加速、真空量子电动力学等方面。从2025-03-10

最新评论